OpenAI AGI安全团队已流失近半成员 AI安全性警钟敲响

OpenAI AGI安全团队已流失近半成员

8月30日,有报道称OpenAI在追求人工智能技术发展以惠及全球的同时,正面临一个不容忽视的问题:大约一半专注于超级智能AI长期风险研究的专家已从该公司离职。这一情况引发了外界对OpenAI可能轻视AI安全性问题的关注。

据前治理研究员Daniel Kokotajlo透露,近期OpenAI内部负责AGI(通用人工智能)安全的团队成员流失近半。这些研究人员的职责是确保未来诞生的AGI系统不会对人类生存构成潜在危险。伴随OpenAI业务重心向产品开发与商业化倾斜,安全研究团队规模的缩减令人担忧。

Kokotajlo指出,自2024年起,该安全团队的成员数已从约30人缩减至16人左右,他相信这一变化源于个人层面的信心缺失而非有组织的行动。

针对上述担忧,OpenAI官方发言人强调,公司致力于提供高效且安全的人工智能解决方案,并自信具备科学应对相关风险的能力。

另外,值得注意的是,OpenAI的联合创始人及首席科学家Ilya Sutskever今年早些时候宣布离职,其领导的专注于安全挑战的“超级对齐”团队也随之解散,进一步加剧了外界对于OpenAI内部安全研究方向变动的猜测。

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如若转载,请注明出处:http://www.rllx.cn/RhlK/112573.gov.cn

如若内容造成侵权/违法违规/事实不符,请联系一条长河网进行投诉反馈邮箱:809451989@qq.com,一经查实,立即删除!相关文章

大众途岳新锐成都车展上市 亲民价格X.XX万起,动力总成终身质保

大众途岳新锐成都车展上市在2024成都车展的舞台上,上汽大众揭幕了其全新车型——途岳新锐,凭借节省公摊、低油耗、强劲动力等特性,迅速成为展会焦点。该车以诱人的起售价“X.XX万起”,加之动力总成终身保修的优惠政策,为购车者提供了更高性价比的选择。上汽大众对途岳新锐…

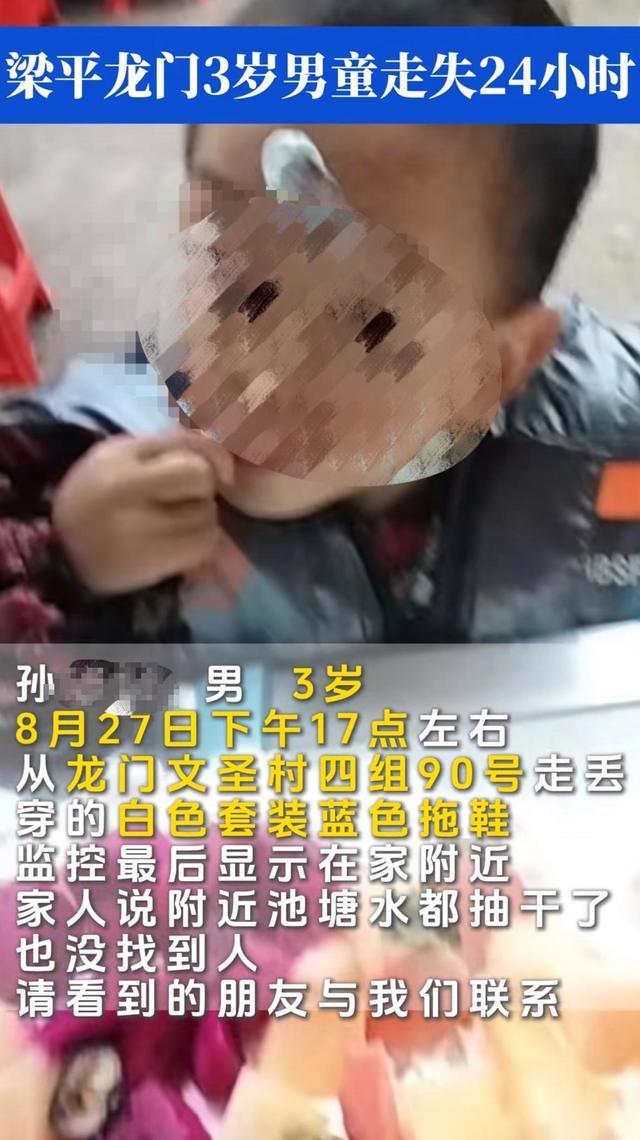

重庆3岁走失男童遗体被找到 垃圾场内揪心发现

重庆3岁走失男童遗体被找到最近,网络上广泛传播着一条关于重庆一名三岁男孩失踪的消息,引起了公众的广泛关注。该寻人信息描述,小男孩名叫孙某某,于8月27日下午5点左右在龙门镇文圣村走失,当时身穿白色服装搭配蓝色拖鞋。监控录像记录下他最后在家中附近出现的身影。尽管家…

国足队员:期待直面强大的日本队

国足队员:期待直面强大的日本队年轻的朋友们,你们是否已蓄势待发,准备好让激情与足球共鸣,在这个特别的夜晚点燃夏末的星空?2024年9月5日,CCTV5的镜头聚焦亚洲区预选赛,中国男足与日本队的对决不仅是比赛,更是中国足球于逆境中的一声呐喊,向世界宣告其不凡之志。夕阳如…

A股开盘:沪指跌0.12% 光伏锂电回调,食品教育走弱

A股开盘:沪指跌0.12%A股市场开盘显示,三大主要股指表现各异,沪指轻微下滑0.12%,深成指近乎平开,下跌幅度仅为0.02%,而创业板指则微幅上扬0.16%。行业方面,光伏与锂电池相关产业链经历调整,与此同时,食品、教育及半导体板块也呈现疲软态势。另一方面,液冷服务器、跨境…

前7个月广义财政收支均下滑 政策加码还有多大空间

根据财政部数据,今年前7个月,全国广义财政收入(一般公共预算收入和政府性基金收入之和)约为15.9万亿元,同比下降约5.4%;其中,7月份同比下降8.3%。全国广义财政支出约19.7万亿元,同比下降约2%,其中7月份广义财政支出同比增长约3.7%;前7个月全国广义财政支出超出收入约…

曝白鹿敖瑞鹏恋情 多方辟谣否认交往

曝白鹿敖瑞鹏恋情8月29日,女演员苏梦芸针对近期流传的绯闻发表声明,澄清了一台风扇引发的误会。她强调说:“这风扇是我送给白鹿的,请大家理性看待,别让我赠送的物品成为朋友今后在现场无法正常使用的原因。”这一发言直接反驳了某些八卦媒体报道的“敖瑞鹏送白鹿电扇以传情…

全红婵陈芋汐合照轴对称 跳水少女甜美笑容融化人心

全红婵陈芋汐合照轴对称跳水界的新星全红婵和陈芋汐在颁奖礼上的风采成为了众人瞩目的焦点。她们身着国家队服,胸挂沉甸甸的奖牌,这是她们不懈努力和汗水的见证。每一次精准的跳水动作,都凝聚了她们对梦想的执着追求,让人既骄傲又心疼。镜头捕捉下的她们,笑容格外迷人。全…

网红冒充仿生机器人 真假难辨引争议

网红冒充仿生机器人8月25日落幕的2024世界机器人大会在北京亦庄举行,其间展出的高仿人形机器人吸引了众多目光。然而,有观众发现,部分看似逼真的“机器人”实际上是穿着特制服装的真人女模特。网络视频显示,互动环节时,一些观众伸手触摸这些模特的脸部,试图抹去口红来辨别…

章子怡威尼斯电影节评审已就位 唯一亚洲面孔闪耀红毯

章子怡威尼斯电影节评审已就位8月29日,章子怡亮相第81届威尼斯电影节主竞赛单元的开幕式红毯,作为该单元唯一的亚洲评审,她的出席引人注目。她选择了一套黑色丝绒高定连体裤,配以黑色贝雷帽、设计独特的耳饰及刺绣折扇,展现出一种含蓄的华丽,同时巧妙地融合了国际时尚与中…

章子怡惊艳亮相威尼斯电影节红毯 东方韵味引赞誉

章子怡惊艳亮相威尼斯电影节红毯8月29日,章子怡在第81届威尼斯电影节主竞赛单元评审团中亮相红毯,成为该届电影节中唯一的亚洲评审成员。她在红毯上的装扮引人注目:一身黑色丝绒高定连体裤,配以黑色贝雷帽、设计独特的耳饰及刺绣折扇,巧妙融合了国际时尚与中国元素,展现出…

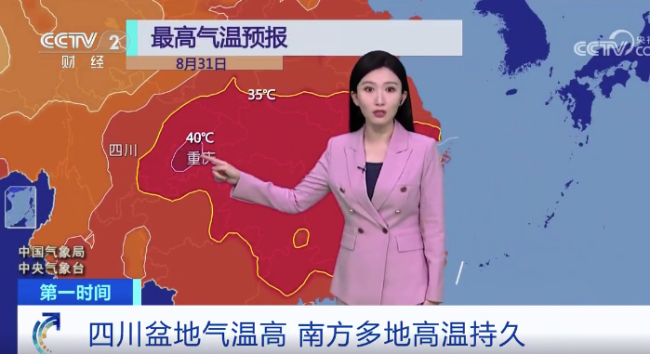

外出穿双厚底鞋 川渝午后出门热到烫脚

8月以来,重庆出现了持续性的高温天气,今后一周,重庆最高气温都将在40℃以上,是历史同期罕见的热。不仅是重庆,四川东部等地也是未来热度最高的地方,最高气温可达40~43℃,午后出门真的会“热到烫脚”。今天开始,江南、华南等更多地方都会回归到高温的行列。南方暑热难消…

全红婵赴港人气高,成晚宴人形打卡点

全红婵赴港人气高奥运冠军们踏上了访问香港的首日旅程,晚宴上,全红婵与孙颖莎成为了众人瞩目的焦点,不断有人请求与她们合影留念。晚宴中,孙颖莎正津津有味地品尝着手中的点心,而全红婵也没能享受多久的闲暇时光,很快就被热情的粉丝邀请合影。两人短暂的相聚被接连不断的…

8月30日最新油价 下周油价调整,预期搁浅

8月30日最新油价油价调整的最新消息指出,将于9月5日24时进行调整。当前的原油变化率为-0.01%,预示着油价可能将保持稳定,调整幅度预计为0元/吨,处于搁浅区间。请大家相互告知,因为下周我们将迎来又一次油价调整。至于今日(8月30日)的汽油和柴油价格,具体数值可参考下方…

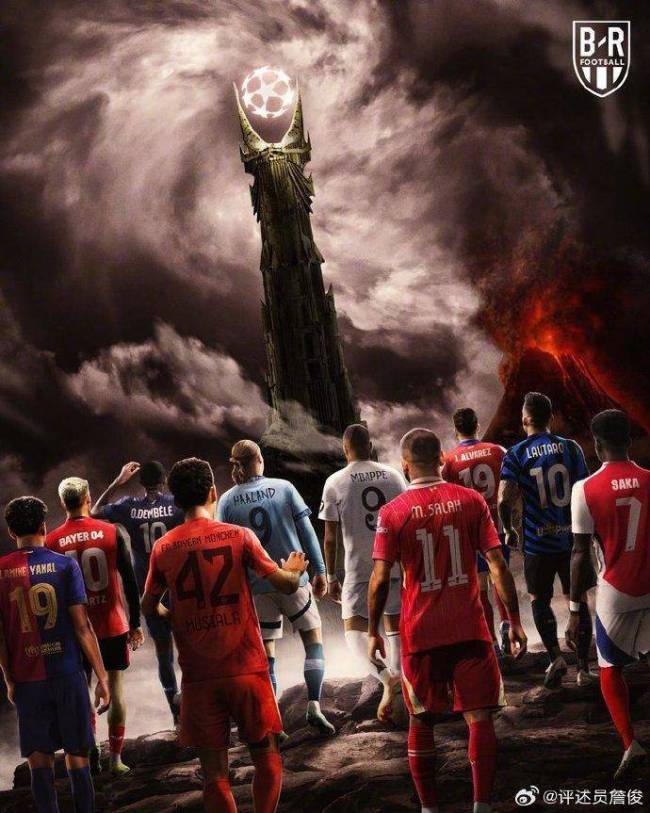

詹俊:新欧冠让排位赛强强较量增加,巴黎挑战升级

詹俊:新欧冠让排位赛强强较量增加30日凌晨,新赛季欧冠抽签结果揭晓,巴黎圣日耳曼面临严峻挑战,其对手中半数为上季欧冠八强行列,包括曼城、阿森纳、马德里竞技及拜仁慕尼黑。曼城首阶段将对阵国际米兰、巴黎圣日耳曼等强队,赛程紧凑,竞争激烈。体育评论员詹俊指出,新采…

恶狗突然扑倒老人撕咬 已被打死 公共安全需警醒

恶狗突然扑倒老人撕咬已被打死8月28日,湖南平江。汽修店内一恶狗突然跳起,扑向老人撕咬其面部,老人被咬后毫无还手之力,摔倒在地。据邻居介绍,老人目前已送往长沙接受治疗。恶狗突然扑倒老人撕咬已被打死!责任编辑:卢其龙 CN070

房贷商转公袭来 北上广会否跟进

当前,全国五年以上首套住房公积金贷款利率为2.85%,低于6月新发放房贷平均利率3.45%“房贷利率从4.25%降到2.85%,月供从3300元降到了2800元。”近日,郑州小伙周民办理了“商转公”业务,房贷利率和月供均出现大幅下降。所谓“商转公”,即商业性住房贷款转公积金住房贷款。2…

女方父亲疑收彩礼后转移他人名下 男方誓追回全款

女方父亲疑收彩礼后转移他人名下山东梁山县一起因彩礼引发的纠纷有了新的发展。在当地法院和警方的介入,以及社会舆论的压力下,女方已向男方归还了31万元彩礼,加之前期退还的2万元,总计退还33万元。然而,根据法院判决,应退还金额为34万元,并且判决中包含若逾期未全额退还…

章子怡晒威尼斯电影节请柬,担任主竞赛单元评委

章子怡晒威尼斯电影节请柬,担任主竞赛单元评委8月28日,章子怡通过社交媒体分享了即将参与威尼斯电影节的请柬,宣告自己正式回归工作状态。她在配文中轻松表示:“假期已告一段落,是时候切换到工作模式了。”随同请柬,章子怡还发布了一张私享照片。照片中,她佩戴着墨镜,不…

多家中介明确50岁以上租客不能合租 年龄门槛引争议

多家中介明确50岁以上租客不能合租近期,有媒体报道揭示,在某地区的租房市场中,多家长租中介机构公开表示不对超过50岁的求租者提供合租服务,部分中介甚至对大龄租户实施特别的审批与管理流程,这一做法引发了社会广泛讨论。实际上,这种年龄限制的现象并非个例,多个城市的…

iPhone16开始印度量产

8月30日消息,苹果2024秋季发布会将于9月10日举行,届时,将发布iPhone 16系列等多款新品。据媒体报道,日前,陷入争议的印度供应链已经开始量产iPhone 16。消息人士表示,印度流水线目前除了组装入门款iPhone 16外,还承接了部分Pro版本订单。根据供应链消息,印度工厂去年组…