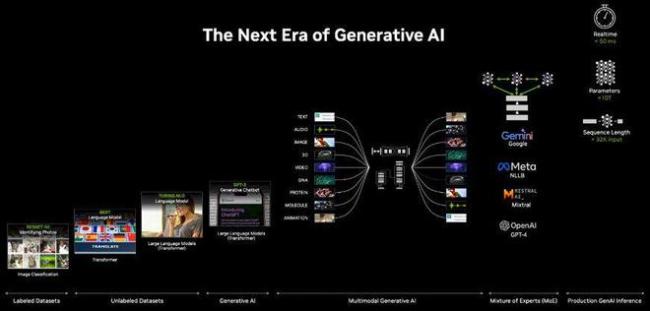

英伟达发布最强AI加速卡Blackwell GB200 计划今年发货

IT之家 3 月 19 日闪讯速报,英伟达发布最强 AI 加速卡--Blackwell GB200,今年发货。

英伟达在今天召开的GTC开发者大会上,正式发布了最强AI加速卡GB200,并计划今年晚些时候发货。

GB200采用新一代AI图形处理器架构Blackwell,黄仁勋在GTC大会上表示:“Hopper固然已经非常出色了,但我们需要更强大的GPU”。

英伟达目前按照每隔2年的更新频率,升级一次GPU架构,从而大幅提升性能。英伟达于2022年发布了基于Hopper架构的H100加速卡,而现在推出基于Blackwell的加速卡更加强大,更擅长处理AI相关的任务。

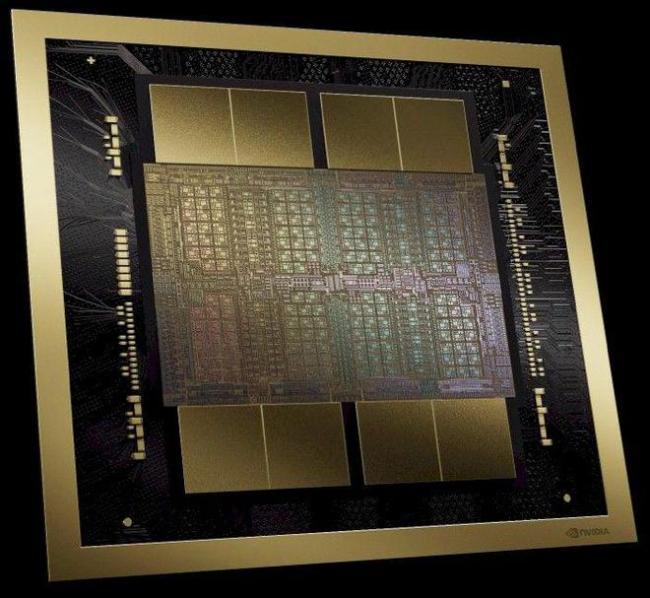

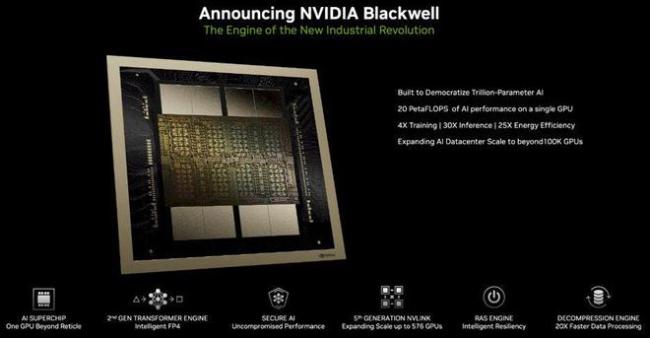

Blackwell GPU

黄仁勋表示,Blackwell的AI性能可达20petaflops,而H100仅为4petaflops。Nvidia 表示,额外的处理能力将使人工智能公司能够训练更大、更复杂的模型。

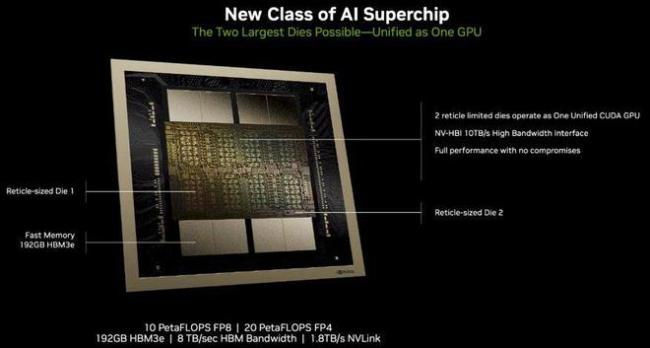

Blackwell GPU 体积庞大,采用台积电的 4 纳米(4NP)工艺蚀刻而成,整合两个独立制造的裸晶(Die),共有 2080 亿个晶体管,然后通过 NVLink 5.0 像拉链一样捆绑芯片。

英伟达表示每个 Blackwell Die 的浮点运算能力要比 Hopper Die 高出 25%,而且每个封装中有两个 Blackwell 芯片,总性能提高了 2.5 倍。如果处理 FP4 八精度浮点运算,性能还能提高到 5 倍。取决于各种 Blackwell 设备的内存容量和带宽配置,工作负载的实际性能可能会更高。

英伟达使用 10 TB / sec NVLink 5.0 连接每块 Die,官方称该链路为 NV-HBI。Blackwell complex 的 NVLink 5.0 端口可提供 1.8 TB / 秒的带宽,是 Hopper GPU 上 NVLink 4.0 端口速度的两倍。

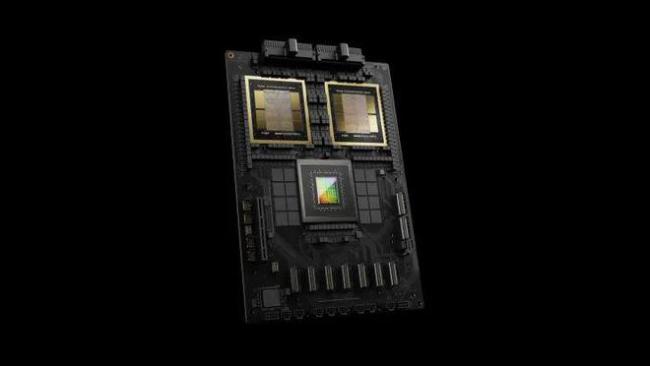

GB200

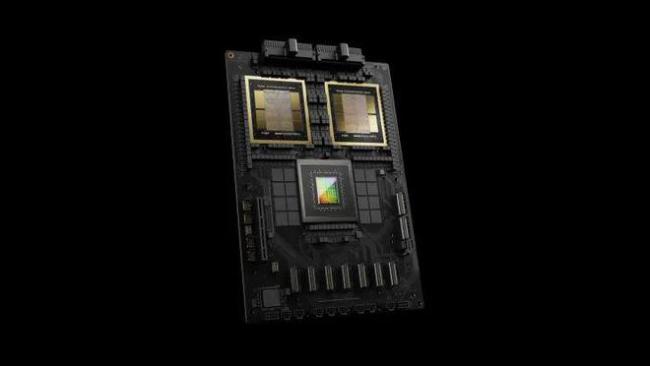

英伟达表示 GB200 包含了两个 B200 Blackwell GPU 和一个基于 Arm 的 Grace CPU 组成,推理大语言模型性能比H100提升30倍,成本和能耗降至25分之一。

Nvidia声称,训练一个1.8万亿个参数的模型以前需要8000 个 Hopper GPU 和 15 兆瓦的电力。如今,Nvidia 首席执行官表示,2000 个 Blackwell GPU 就能完成这项工作,耗电量仅为 4兆瓦。

在参数为1,750亿的GPT-3LLM基准测试中,Nvidia称GB200的性能是H100的7倍,而训练速度是 H100的4倍。

英伟达还面向有大型需求的企业提供成品服务,提供完整的服务器出货,例如GB200NVL72服务器,提供了36 个 CPU 和 72 个 Blackwell GPU,并完善提供一体水冷散热方案,可实现总计 720petaflops的AI训练性能或1,440petaflops(又称1.4exaflops)的推理性能。它内部使用电缆长度累计接近 2英里,共有 5000 条独立电缆。

机架上的每个托盘包含两个GB200芯片或两个NVLink交换机,每个机架有18个GB200芯片和9个NVLink交换机,英伟达称,一个机架总共可支持27万亿个参数模型。而作为对比,GPT-4的参数模型约为1.7万亿。

该公司表示,亚马逊、谷歌、微软和甲骨文都已计划在其云服务产品中提供NVL72机架,但不清楚它们将购买多少。

英伟达表示亚马逊AWS已计划采购由2万片GB200芯片组建的服务器集群,可以部署27万亿个参数的模型。

Nvidia 也乐于为公司提供其他解决方案。下面是用于 DGX GB200 的 DGX Superpod,它将八个系统合而为一,总共拥有 288 个 CPU、576 个 GPU、240TB 内存和 11.5 exaflops 的 FP4 计算能力。

英伟达称,其系统可扩展至数万GB200超级芯片,并通过其新型Quantum-X800InfiniBand(最多144个连接)或Spectrum-X800以太网(最多64个连接)与800Gbps网络连接在一起。

英伟达目前并未公布GB200以及整套方案的售价信息。

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如若转载,请注明出处:http://www.rllx.cn/rjkn/5700.gov.cn

如若内容造成侵权/违法违规/事实不符,请联系一条长河网进行投诉反馈邮箱:809451989@qq.com,一经查实,立即删除!