OpenAI推出新旗舰模型GPT-4o 有情绪的AI时代来临

OpenAI推出新旗舰模型GPT-4o

北京时间周二凌晨1点,OpenAI举办了一场春季发布会,向公众展示了一系列与ChatGPT相关的创新。发布会核心内容包括发布新旗舰模型“GPT-4o”以及在ChatGPT中增加更多免费功能。

GPT-4o作为本次发布会的重头戏,标志着OpenAI在人机交互领域迈出了重要一步。这款模型能够实时处理音频、视觉和文本信息,显著提升了ChatGPT的语言处理能力,支持50种不同语言,并在处理速度和质量上有所突破。与旧模型相比,GPT-4o在理解图像和音频方面更为出色,能在极短时间内对音频输入做出响应,接近人类对话的自然节奏。演示中,它能识别用户的紧张情绪并给予指导,还能根据需求调整语调,展现出高度的情境适应性。

性能方面,GPT-4o不仅在文本、推理和编码等基础能力上保持高水平,其多语言、音频和视觉处理能力更是达到了前所未有的标准。这种跨模态的进步被视作AI领域的一大变革,使得AI能够更全面地理解和响应用户的个人情境和需求。OpenAI推出新旗舰模型GPT-4o。

更令人兴奋的是,GPT-4o的手机版通过语音和视觉识别技术,不仅能理解用户的言语和身体状态,还能根据所处环境作出互动,比如解答数学问题后参与生活话题的讨论,实现了真正的个性化交流体验。

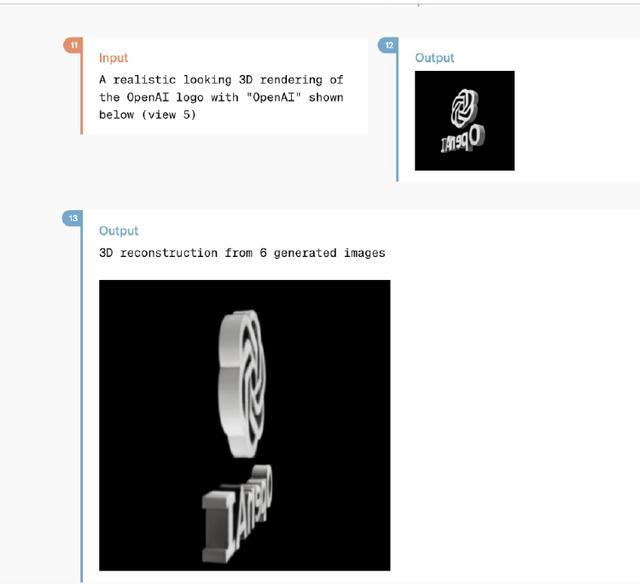

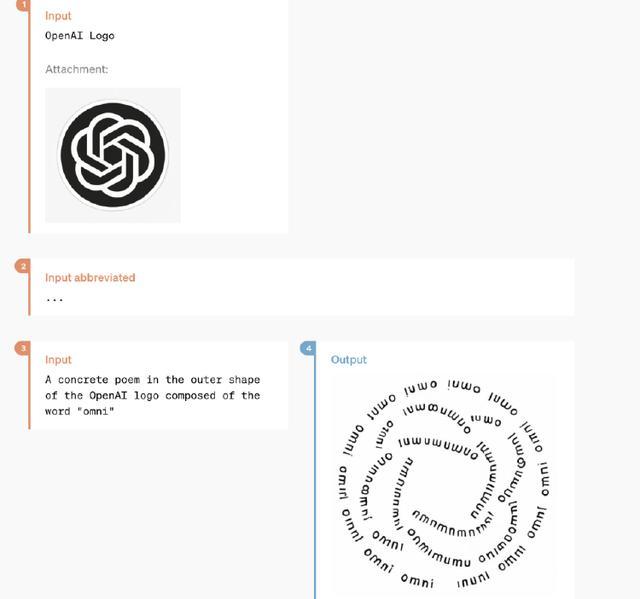

OpenAI透露,GPT-4o是首个集成了文本、视觉和音频处理的模型,目前团队正初步探索其潜能和局限。技术文档中还提及了模型的其他能力,如3D建模、图像诗创作及照片卡通化等,预示着GPT-4o的应用前景广阔。

至于ChatGPT的更新,免费用户现在也能体验到GPT-4o带来的数据分析、图像分析等高级功能,付费用户则享受更高的消息限制。未来,OpenAI计划为Plus用户提供增强的语音体验,并推出适用于macOS的ChatGPT桌面应用,Windows版预计后续跟进。OpenAI推出新旗舰模型GPT-4o。

OpenAI首席执行官Sam Altman在社交媒体上高度评价GPT-4o,称其为公司迄今为止最先进、最快捷且原生支持多模态的模型,暗示着AI技术正朝着更加智能、全面的方向快速发展。

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如若转载,请注明出处:http://www.rllx.cn/sSJt/28928.gov.cn

如若内容造成侵权/违法违规/事实不符,请联系一条长河网进行投诉反馈邮箱:809451989@qq.com,一经查实,立即删除!