GPT4o可检测人的情绪 实时情感感知技术新进展

GPT4o可检测人的情绪

北京时间周二凌晨1点,OpenAI在久违的春季发布会上,由首席技术官米拉·穆拉蒂揭晓了与ChatGPT相关的多项更新。发布会核心内容包括两项重大进展:一是推出了GPT-4o多模态大模型,此模型相较于GPT-4 Turbo在速度及成本上均有优化;二是宣布ChatGPT的免费用户也能享受到GPT-4o带来的升级体验,如数据分析、图像分析等功能,这无疑将极大拓展GPT应用商店的用户基础。

对于付费用户,OpenAI提升了消息限制,至少是免费用户限额的五倍。当免费用户额度耗尽后,系统将自动降级至GPT-3.5。未来一个月内,Plus用户还将迎来基于GPT-4o优化的语音体验,尽管当前GPT-4o API尚不包含语音功能。此外,macOS用户将率先获得ChatGPT桌面应用,Windows版本预计年内推出。

米拉·穆拉蒂在直播中强调,这是公司在易用性方面取得的重要进步。OpenAI,这家估值超800亿美元的微软支持企业,正努力维持其在生成式AI市场的领先地位,并探索盈利途径,以平衡巨额的硬件与基础设施投资。GPT4o可检测人的情绪。

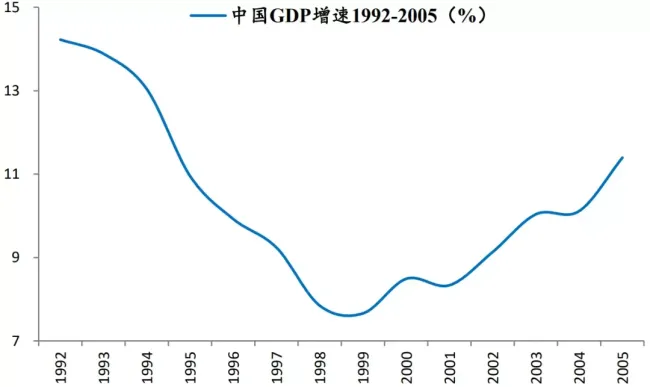

GPT-4o在实时语音和音频处理的安全性方面展现出亮点,如准确识别用户情绪、进行实时口译等。演示中,GPT-4o不仅作为数学辅导助手,还能即时翻译意大利语,并尝试通过面部表情识别情绪,尽管这项功能尚存挑战。OpenAI透露,GPT-4o能与代码库互动,分析数据图表,并基于文本及图像输入提供反馈,语音和视频功能也将逐步上线。

据统计,2023年生成式AI领域投资创新高,市场预期未来十年将突破万亿美元。ChatGPT自2022年11月发布以来,用户量飞速增长,接近1亿大关,广泛应用于《财富》500强企业。穆拉蒂承诺,未来数周内,更多功能将面向大众开放,并对英伟达提供的技术支持表达了感谢。

GPT-4o的推出标志着人机交互更加自然,其快速的音频响应时间(最快232毫秒)接近人类水平,同时在跨语言处理和多媒体理解上实现了显著提升。OpenAI指出,GPT-4o是首个集成了文本、视觉、音频处理的模型,虽然仍处于功能探索阶段,但它预示着AI技术在综合感知与理解能力上的重要飞跃。

GPT4o可检测人的情绪。

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如若转载,请注明出处:http://www.rllx.cn/kDaW/28907.gov.cn

如若内容造成侵权/违法违规/事实不符,请联系一条长河网进行投诉反馈邮箱:809451989@qq.com,一经查实,立即删除!